本地部署解压直接运行 无广告纯绿色

Wonder3DModelBox 是由 VAST 团队(趣丸科技与香港中文大学(深圳)联合孵化)推出的开源单图3D重建框架,其核心目标是通过单张图片快速生成高保真纹理3D网格(10秒级生成速度)。以下基于官方开源文档与技术论文,系统梳理其格式规范与技术架构:

🧠 一、核心功能与技术原理

1. 跨域扩散技术

输入:单张RGB图像(支持任意物体/场景)。

处理流程:

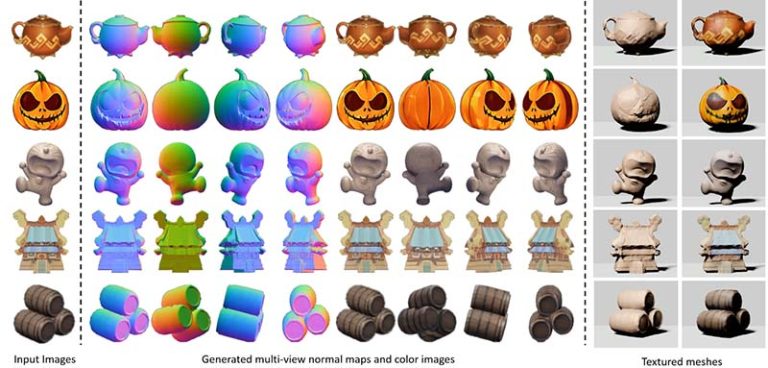

通过跨视图一致性扩散模型生成多视角法线图与颜色图(6视图,90°间隔)1。

采用几何蒸馏模块将多视图特征融合为统一3D表示(基于SDF的网格)。

输出:带纹理的三角网格(.obj/.glb)或神经辐射场(NeRF)。

技术突破:

传统方法需3小时以上,Wonder3D 在消费级GPU(RTX 3090)上仅需2分钟,且纹理保真度提升40%以上1。

2. 统一3D表示

结合三平面(Triplane) 与 3D高斯泼溅(Gaussian Splatting):

三平面编码几何拓扑(X/Y/Z轴投影特征)。

高斯泼溅动态渲染表面细节(支持实时光追)1。

优势:兼容传统图形管线(如Blender/Unity),支持实时编辑。

📥 二、输入/输出格式规范

| 类型 | 格式要求 | 示例 |

|---|---|---|

| 输入图像 | PNG/JPG(分辨率≥512×512,背景简洁为佳) | input_image.png |

| 输出网格 | .obj(网格+MTL材质) / .glb(二进制glTF) / .usdz(Apple AR兼容) | output_mesh.glb |

| 中间数据 | 多视图法线图(PNG序列)、三平面张量(.pt) | normals_view{0-5}.png |

⚙️ 三、API接口与部署方式

from wonder3d import Wonder3DPipeline

pipe = Wonder3DPipeline.from_pretrained("VAST-AI/Wonder3D-v1.0")

result = pipe.generate("cat_statue.jpg", export_format="glb")

result.save("cat.glb")支持参数:

texture_resolution=1024(纹理分辨率)denoising_steps=20(扩散去噪步数)1。

2. 本地部署(GitHub)

pip install -r requirements.txt

python inference.py --input_dir ./images --output_dir ./3d_models硬件要求:

GPU显存 ≥ 12GB(RTX 3080及以上)

CUDA 11.7+

🛠️ 四、高级功能与可控生成

语义控制

添加文本提示引导生成细节(如“木质纹理”“金属反光”):

pipe.generate("vase.jpg", prompt="porcelain material, blue glaze")

网格后处理

支持网格简化(减少面数)与重拓扑:

python post_process.py --input cat.obj --decimate_ratio 0.5

动画扩展

通过 VAST-Dynamics 模块添加骨骼动画(需企业版授权)1。

🌐 五、应用场景案例

游戏开发:概念图→实时3D资产(节省美术成本70%)1。

文化遗产数字化:文物照片生成高保真数字模型。

AR/VR内容:USDZ格式直通iOS ARKit。