本地部署解压直接运行 无广告纯绿色

SadTalker Video一款先进视频生成工具,专注于通过单张参考图像和音频驱动生成具有丰富表情和唇形同步的虚拟人物视频。它基于深度学习技术,结合了语音识别、面部表情生成和视频合成等多种技术,能够生成高质量、逼真的视频内容。

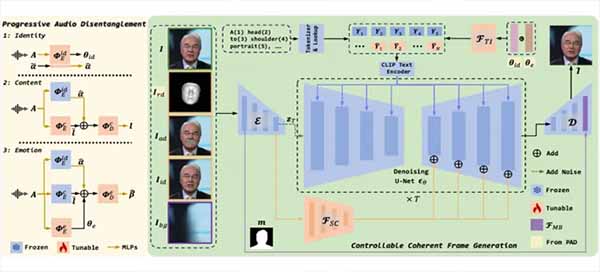

二、技术原理与创新

SadTalker Video的核心技术原理和创新点包括:

- 深度学习模型:

- 采用先进的神经网络架构,如生成对抗网络(GAN)或Transformer,以捕捉视频信号中的复杂模式。

- 通过大量的视频数据进行训练,学习面部表情、唇形运动和语音之间的关联。

- 语音驱动面部动画:

- 利用语音信号中的信息,生成与语音内容相匹配的面部表情和唇形运动。

- 通过注意力机制等技术,确保生成的面部表情和唇形运动与语音信号的高度同步。

- 3D面部重建:

- 基于单张参考图像,重建出三维面部模型,为面部表情生成提供基础。

- 通过优化算法,确保重建出的三维面部模型与参考图像的高度一致性。

- 实时视频合成:

- 支持实时视频合成,算法延迟低,适用于在线会议、直播等实时性要求高的场景。

三、核心功能与应用场景

- 核心功能:

- 语音驱动面部动画:根据输入的音频,生成与语音内容相匹配的面部表情和唇形运动。

- 3D面部重建:基于单张参考图像,重建出三维面部模型。

- 实时视频合成:支持实时视频合成,生成高质量、逼真的视频内容。

- 多情感表达:支持生成多种情感状态下的面部表情,如快乐、悲伤、愤怒等。

- 应用场景:

- 虚拟主播与数字人:为虚拟主播和数字人提供面部表情和唇形同步服务。

- 影视制作与动画:为影视作品和动画生成逼真的面部表情和唇形运动。

- 在线教育与培训:为在线教育和培训提供生动的视频教学内容。

- 实时语音转换与变声:结合语音转换技术,实现实时语音转换和变声聊天。